Inteligența artificială în medicină. Precizie de algoritm, răspundere de medic

12 martie 2026 / Irina Bustan

Inteligența artificială este deja prezentă în multe unități medicale din România. Este utilizată, printre altele, în radiologie pentru interpretarea imaginilor, în laboratoare pentru analiza rezultatelor, în triaj pentru evaluarea pacienților. Beneficiile sunt evidente: precizie crescută, timp de așteptare și de consultație redus, un al doilea set de ochi în procesul de diagnostic și multe altele.

Iar clienții noștri le valorifică deja. Nu suntem aici să frânăm inovația, ci să ne asigurăm că pot beneficia de tot ce poate oferi inteligența artificială, pe un teren juridic sigur atât pentru pacient, cât și pentru medic și unitatea medicală.

Pentru că AI nu este un simplu instrument tehnic. Este un factor care poate influența decizia medicală, siguranța pacientului și răspunderea medicului. Tocmai de aceea, Regulamentul (UE) 2024/1689 privind inteligența artificială (AI Act) califică majoritatea instrumentelor AI utilizate în domeniul sănătății drept sisteme cu risc ridicat.

Iar din 2 august 2026, conformitatea nu mai este o obligație doar în sarcina furnizorului de sistem AI. În sarcina implementatorilor, adică a unităților medicale care utilizează aceste sisteme, intră în vigoare o serie de obligații directe, în temeiul Regulamentului. Le vom trata pe cele mai importante.

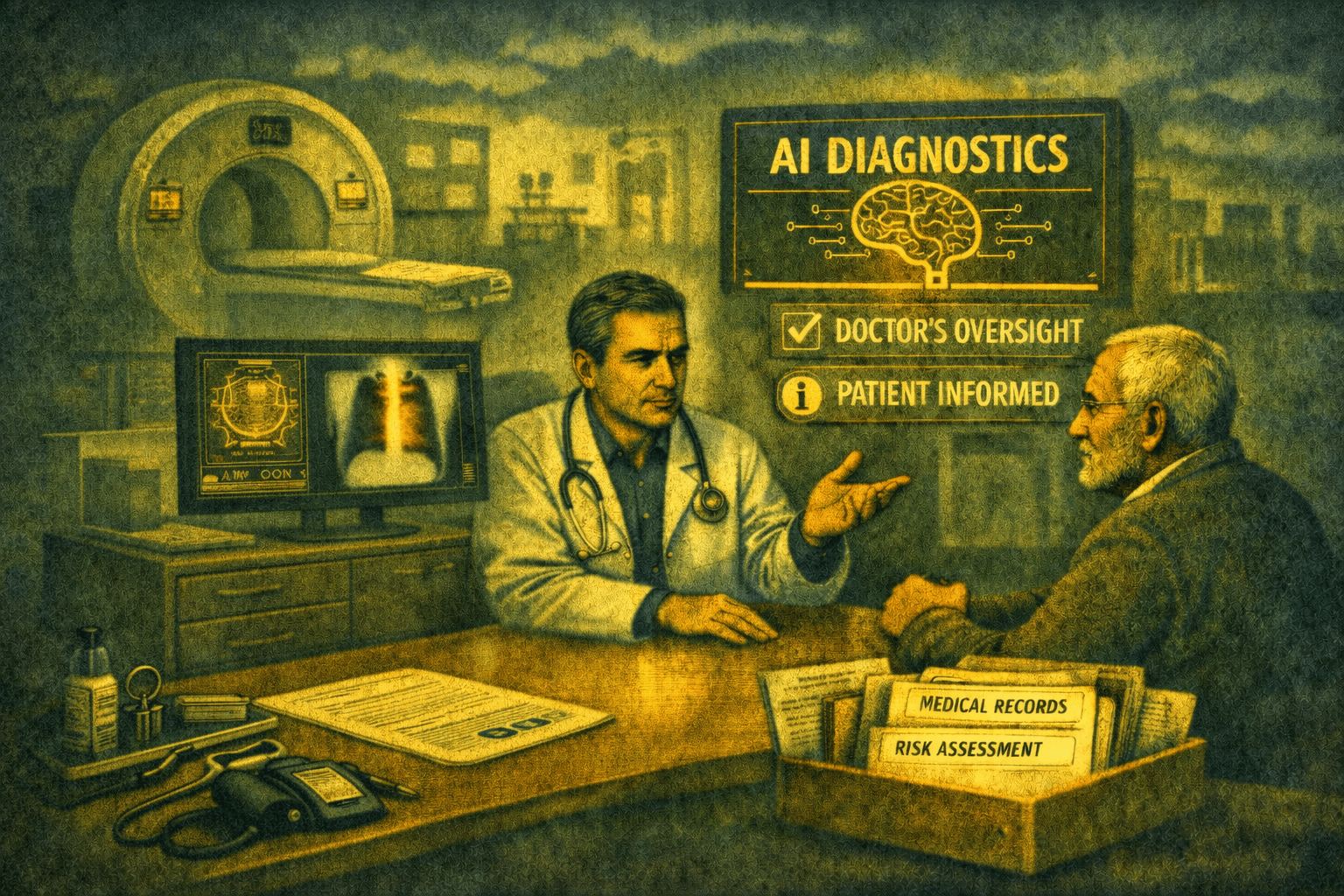

1. Supravegherea umană, mai mult decât un checkbox de conformitate

Art. 14 din AI Act impune persoanei care supraveghează un sistem AI să înțeleagă rezultatul sistemului, să îl interpreteze corect și, dacă este necesar, chiar să îl ignore.

Teoria este clară. Practica, mai puțin. Pentru ca un medic să decidă când să pună sub semnul întrebării un rezultat AI sau când să îl ignore, nu trebuie să știe cum funcționează algoritmul. Nu acesta este rolul lui.

Medicul trebuie să cunoască limitele sistemului AI cu care lucrează: în ce situații scade performanța, ce patologii sunt detectate greu sau deloc, unde are rată mai mare de fals negativ, cum se comportă pe anatomii atipice sau patologii suprapuse.

Informații care cel mai probabil există în documentația furnizorului, dar care rareori ajung la medicul din practică. De cele mai multe ori, implementarea AI-ului vine însoțită de training operațional: interfață, workflow, integrare în fluxul clinic. Toate necesare, dar insuficiente.

În realitate, medicul învață cum să folosească sistemul, însă mult mai rar învață când să fie circumspect. Iar fără o înțelegere reală a limitărilor sistemului, supravegherea umană riscă să rămână mai degrabă un checkbox de conformitate decât un mecanism real de control, cu consecințe evidente în materia răspunderii medicului.

Dacă vrem ca integrarea AI-ului în dispozitivele medicale să fie sustenabilă – clinic și juridic – atunci informația despre limite trebuie să fie la fel de vizibilă ca informația despre performanță.

2. Transparența față de pacient: obligație, nu opțiune

AI Act impune obligații de transparență atunci când sunt utilizate sisteme AI cu risc ridicat, categorie în care se încadrează majoritatea sistemelor AI utilizate în domeniul sănătății.

Separat, GDPR impune transparență în cazul deciziilor automatizate. Cele două reglementări nu se exclud, ci se aplică simultan.

Deși poate părea doar o formalitate în plus, în realitate ea acoperă un real risc juridic; aceasta deoarece pacientul care află ulterior despre utilizarea AI poate contesta valabilitatea consimțământului informat. De aici și până la o acuzație de malpraxis, distanța este mică.

Mai mult, AI Act prevede amenzi de până la 15 milioane de euro sau 3% din cifra de afaceri pentru încălcarea obligației de transparență. Iar cel mai subestimat risc rămâne pierderea încrederii. Pacientul care simte că i s-a ascuns ceva nu revine și spune mai departe.

Așadar, ce presupune, în practică, o informare conformă? Nu există un formular universal, dar există întrebări care trebuie clarificate: Cine comunică? În ce moment? Cum dovedim că informarea a avut loc? Ce facem dacă pacientul refuză utilizarea AI? Răspunsurile nu vin de la furnizor. Cadrul de transparență este responsabilitatea unității medicale.

3. Documentația care gestionează riscurile

Când răspunderea pentru instrumentul AI utilizat nu mai aparține doar furnizorului, ci și unității medicale, este de datoria acesteia să demonstreze, pe bază documentară:

- că AI-ul este utilizat conform scopului medical și instrucțiunilor furnizorului,

- că riscurile sunt evaluate și monitorizate continuu,

- că decizia medicală aparține medicului și

- că există proceduri interne pentru utilizarea AI și mecanisme concrete de implementare.

Întrebările de mai jos sunt un punct de plecare bun:

Știți exact ce sisteme AI utilizați și care e nivelul de risc pentru fiecare? Aveți documentația necesară pentru a demonstra conformitatea într-o procedură de control? Personalul medical cunoaște nu doar cum să folosească AI-ul, ci și când să nu se bazeze pe el? Pacientul este informat despre utilizarea AI înainte să afle din altă parte?

Dacă la oricare dintre aceste întrebări răspunsul nu este un „da” ferm, riscurile sunt deja prezente. Termenul de 2 august 2026 nu este flexibil, iar o documentație de conformitate solidă necesită timp, atât pentru elaborare, cât și pentru implementare.

Colaborând cu specialiști în auditare de algoritmi AI, echipa noastră asigură conformitatea cu AI Act și oferă unităților medicale pârghiile necesare pentru gestionarea riscurilor juridice generate de utilizarea AI în practica medicală. Nu prin furnizarea de documentație generică, ci adaptată și personalizată pentru fiecare unitate medicală în parte, apoi integrată efectiv în fluxul clinic.